The Cloud Platform

to boost Customer Experience and

E-commerce sales

- Optimize delivery chain through AI

- Native 103 early hints implementation

- Maximizes server offload through AI-driven HTML caching

The Cloud Platform

to boost Customer

Experience and E-commerce sales

- Optimize delivery chain through AI

- Native 103 early hints implementation

- Maximizes server offload through AI-driven HTML caching

Global network with 9 data center

~ 27 ms

average TTFB on HTML

800 Mio

daily request peak

87%

average cache hit ratio included HTML

100%

Sla with uptime

Bring websites performance to a next level

Assets optimization

iSF improves the assets manipulating images, codes, and texts, caching them using an AI-driven algorithms.

Maximise website performances

With iSmartFrame your website can benefit from remarkable performances improvement measurable with Google Page Speed Insight and Core Web Vitals.

103 ‘Early Hints’ at its best!

iSF redefines the logics and sequences of website’s distribution chain. It uses 103 status code for critical assets preloading.

iSF is Certified ISO 27001, the highest standard for information security management and an anti DDos Level1 protection.

Reliability

With a 100% SLA guarantee and proprietary DNS, load balancing can be managed on every Data Center

Compliancy

iSmartFrame is fully compliant with GDPR requirements for data manipulation.

- Customized service

Our team is available to provide the service needed to suit customers needs and meet specific goals.

- Global proprietary CDN

Deliver cache purge and settings immediately.

- Free trial and assistance

We’ll walk you towards a new top-quality website.

- Custom setup process

The best integration in your delivery architecture.

- Smart Caching system

Set the cache up for your needs.

- Adjustable Pricing

To maximise customer satisfaction, we will formulate an offer according with the client.

- Custom pricing

Define a plan to get the best UX desired.

- No hidden costs

The contract is defined along with the customer

- Flexible and competitive

iSF generates savings up to 87% on Server Calls

- Unique pricing

for CDN and performance improvement..

- 24/7 technical support

In case of an issue, you’ll be able to contact our technical support team any day, any time.

- Ticketing system

Practical tool to quickly submit a request for assistence.

- Direct support

Technical and network teams are at your disposal.

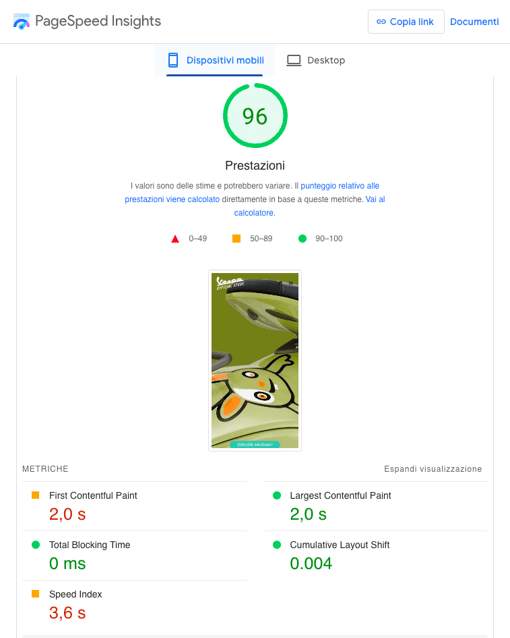

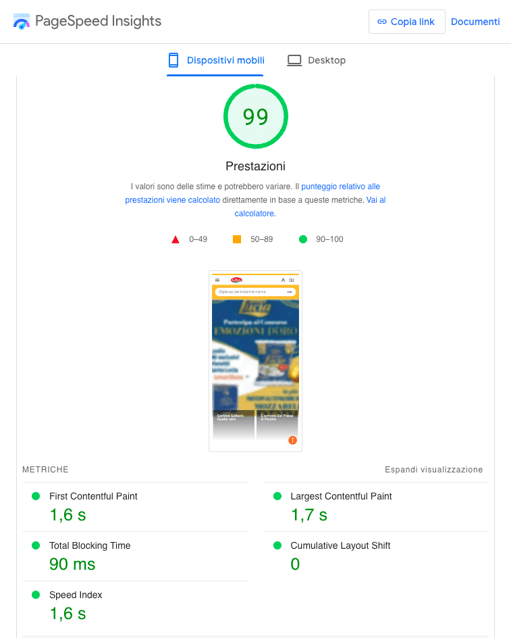

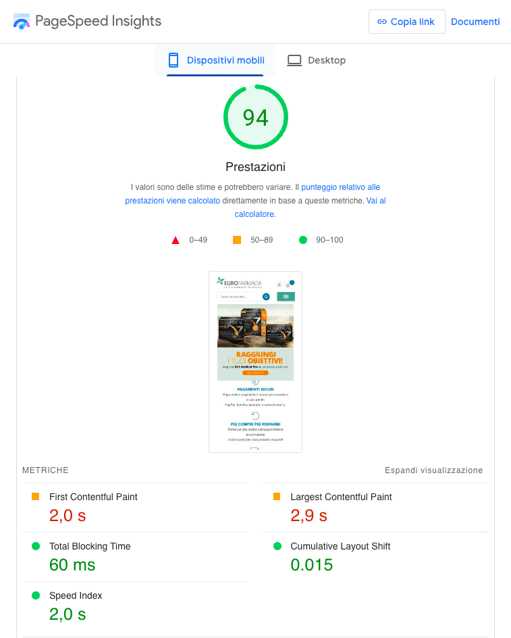

Some recent results:

Galbani

Eurofarmacia

Vespa